La transmisión 3D se vuelve más delgada al ver solo lo que importa

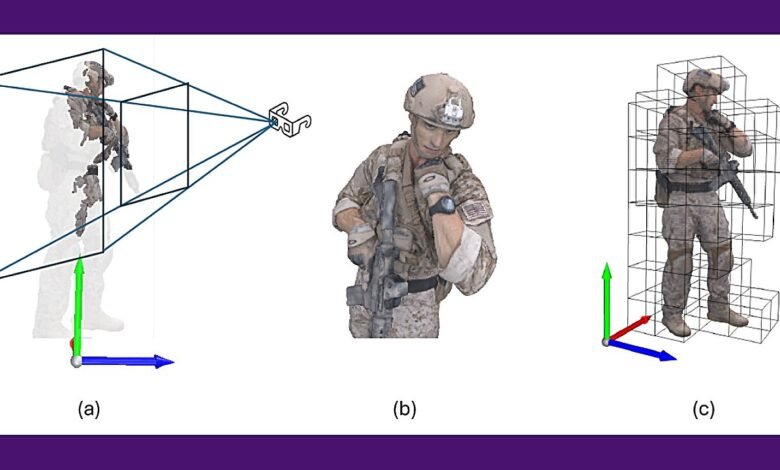

(a) La pirámide de visualización define contenido potencialmente visible entre planos cercanos y lejanos; Solo los puntos resaltados son realmente visibles desde el punto de vista. (b) La vista resultante vista por el espectador. (c) Al dividir la nube de puntos en las células 3D, solo aquellos que contienen puntos visibles necesitan transmisión, optimizando el uso de datos. Crédito: Actas de la 16ª Conferencia de Sistemas Multimedia ACM (2025). Doi: 10.1145/3712676.3714435

Un nuevo enfoque para la tecnología de transmisión puede mejorar significativamente la forma en que los usuarios experimentan la realidad virtual y los entornos de realidad aumentada, según un estudio de la Escuela de Ingeniería de la NYU Tandon.

La investigación, presentada en un documento en la 16ª Conferencia de Sistemas Multimedia ACM (ACM MMSYS 2025) el 1 de abril de 2025, describe un método para predecir directamente el contenido visible en entornos 3D inmersivos, reduciendo potencialmente los requisitos de ancho de banda mediante hasta 7 veces la calidad visual.

La tecnología se está aplicando en un proyecto en curso de NYU Tandon para traer videos en la nube de puntos a la educación de la danza, lo que hace que la instrucción de baile en 3D sea transmitible en dispositivos estándar con requisitos de menor ancho de banda.

“El desafío fundamental con la transmisión de contenido inmersivo siempre ha sido la cantidad masiva de datos requeridos”, explicó Yong Liu, profesor en el Departamento de Ingeniería Eléctrica e Informática (ECE) en NYU Tandon y el miembro de la facultad de NYU Tandon para Tecnología Avanzada de Telecomunicaciones (Catt) y NYU Wireless, dirigieron el equipo de investigación.

“La transmisión de video tradicional envía todo dentro de un marco. Este nuevo enfoque es más como que sus ojos lo sigan en una habitación, solo procesa lo que realmente está viendo”.

La tecnología aborda el desafío “campo de visión (FOV)” para experiencias inmersivas. Las aplicaciones actuales de AR/VR exigen un ancho de banda alto: un video de nube de puntos (que hace escenas 3D como colecciones de puntos de datos en el espacio) que consta de 1 millón de puntos por cuadro requiere más de 120 megabits por segundo, casi 10 veces el ancho de banda del video estándar de alta definición.

A diferencia de los enfoques tradicionales que primero predicen dónde se verá un usuario y luego calcula lo que es visible, este nuevo método predice directamente la visibilidad de contenido en la escena 3D. Al evitar este proceso de dos pasos, el enfoque reduce la acumulación de errores y mejora la precisión de la predicción.

El sistema divide el espacio 3D en “celdas” y trata cada celda como un nodo en una red gráfica. Utiliza redes neuronales gráficas basadas en transformadores para capturar relaciones espaciales entre las células vecinas y las redes neuronales recurrentes para analizar cómo evolucionan los patrones de visibilidad con el tiempo.

Para las experiencias de realidad virtual pregrabadas, el sistema puede predecir lo que será visible para un usuario de 2 a 5 segundos por delante, una mejora significativa sobre los sistemas anteriores que solo podría predecir con precisión el FOV de un usuario una fracción de segundo por delante.

“Lo que hace que este funcione sea particularmente interesante es el horizonte del tiempo”, dijo Liu. “Los sistemas anteriores solo podían predecir con precisión lo que un usuario vería una fracción de segundo por delante. Este equipo lo ha extendido”.

El enfoque del equipo de investigación reduce los errores de predicción hasta un 50% en comparación con los métodos existentes para las predicciones a largo plazo, al tiempo que mantiene el rendimiento en tiempo real de más de 30 cuadros por segundo incluso para videos de nubes de puntos con más de 1 millón de puntos.

Para los consumidores, esto podría significar experiencias AR/VR más receptivas con un uso reducido de datos, mientras que los desarrolladores pueden crear entornos más complejos sin requerir conexiones a Internet ultra rápidas.

“Estamos viendo una transición en la que AR/VR se está moviendo de aplicaciones especializadas al entretenimiento del consumidor y herramientas de productividad cotidiana”, dijo Liu. “El ancho de banda ha sido una restricción. Esta investigación ayuda a abordar esa limitación”.

Los investigadores han publicado su código para apoyar el desarrollo continuo.

Más información: Chen Li et al, Visibilidad espacial y dinámica temporal: Repensar la predicción del campo de visión en la transmisión de video de la nube de puntos adaptativos, Actas de la 16ª Conferencia de Sistemas Multimedia ACM (2025). Doi: 10.1145/3712676.3714435

Proporcionado por la Escuela de Ingeniería NYU Tandon

Cita: la transmisión 3D se vuelve más delgada al ver solo lo que importa (2025, 9 de abril) Recuperado el 9 de abril de 2025 de https://techxplore.com/news/2025-04-3d-streaming-leaner.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.